Liebe Community Sehr geehrte Damen und Herren vom Support,

wir haben jetzt seit 2 Jahren die Cloud laufen und nach jedem Update habe ich Beschwerden.

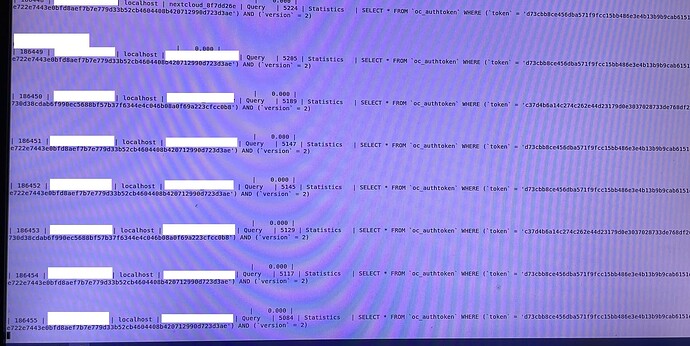

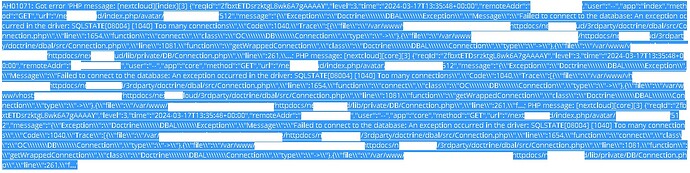

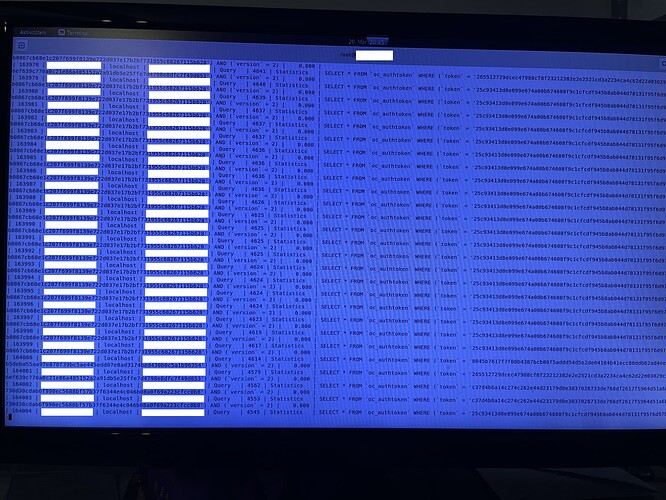

Die neue berechtigte beschwerde lautet, nach einer unbekannten Zeit X bricht die Cloud auf allen Endgeräten zusammen die Cloud ist nicht bedienbar. Als Administrator konnte ich die Ursache noch nicht ermitteln, aber die Cloud und Endgeräte produzieren massiv viele Connection die nicht beendet werden, das heißt mit dem Befehl plesk db “SHOW FULL PROZESSLIST” sind tausende Einträge die nicht beendet werden. Ja ich habe die Prozesse auf 1000 erhöht nachdem bei Version 27 die Probleme aufgetreten waren.

Nachdem ich den Server Neu Starten muss weil auf Plesk hab ich kein Zugriff sind4 prozesse sichtbar das ist normal. Das heißt je länger die Cloud läuft um so mehr Prozesse werden nicht sauber gestoppt und meistens ist das über mitternacht der Fall.